Formation Data Engineer : les compétences essentielles pour l’IA et la BI moderne

Comment recruter, former et fidéliser un Data Engineer qui génère réellement de la valeur pour votre BI et vos projets IA ?

Pour une direction des Ressources Humaines ou une DSI, la question n’est plus théorique. Selon France Travail (BMO 2025), les métiers de la data figurent parmi les profils les plus tendus du numérique, avec des délais de recrutement qui s’allongent et des packages en forte hausse. Dans le même temps, d’après dbt Labs (2025), les compétences attendues d’un Data Engineer évoluent vite : Python, SQL, cloud, orchestration, mais aussi data storytelling, gouvernance et MLOps. Cet article propose un référentiel opérationnel pour structurer un plan de recrutement et de montée en compétences.

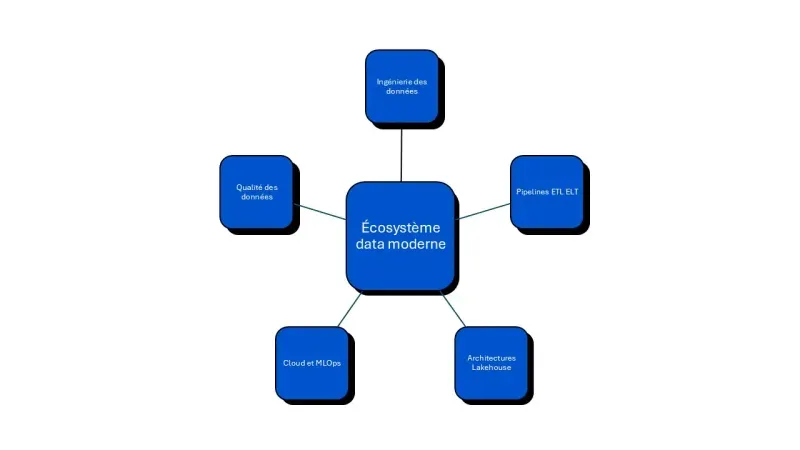

I. Le socle technique : maîtriser l’écosystème Data moderne

Quel est l’écosystème Data moderne ?

La première dimension du rôle de Data Engineer est la maîtrise complète de l’infrastructure qui supporte le cycle de vie de la donnée. Sans une base technique robuste, toute initiative data — qu’il s’agisse de BI ou d’IA — est vouée à l’échec. Pour un DSI, cette couche détermine la capacité de l’entreprise à délivrer des cas d’usage fiables et scalables.

a. Ingénierie des données : Collecte, stockage et traitement

Le cœur du métier de data engineering consiste à concevoir des pipelines performants. Le Data Engineer crée les systèmes qui collectent les données depuis des sources multiples (ERP, CRM, objets connectés), les nettoient pour en garantir la qualité, puis les transforment en un format exploitable pour les Data Scientists et les analystes BI. Selon dbt Labs (2025), l’automatisation de la préparation des données reste le levier n°1 pour accélérer les projets analytiques.

Les compétences clés à ce niveau incluent :

- Langages de programmation : maîtrise de Python et SQL comme standards incontournables.

- Outils ETL/ELT : connaissance des solutions comme Fivetran, Airbyte ou des frameworks comme Apache Airflow pour orchestrer les flux.

- Qualité des données : mise en place de processus de validation et de nettoyage pour assurer la fiabilité des informations.

b. Référentiel de compétences par niveau d’expérience

Pour cadrer vos recrutements et vos plans de formation, le tableau suivant synthétise les attendus par séniorité. Il peut servir de grille d’évaluation RH.

| Niveau | Expérience | Compétences techniques clés | Soft skills attendues | Fourchette salariale (France, 2025) |

|---|---|---|---|---|

| Junior | 0–2 ans | Python, SQL, bases Airflow, un cloud (AWS/Azure/GCP) | Curiosité, rigueur, esprit d’équipe | 42–50 K€ bruts |

| Intermédiaire | 2–5 ans | dbt, Snowflake/BigQuery, CI/CD, qualité des données | Autonomie, communication, sens produit | 55–70 K€ bruts |

| Senior | 5 ans et + | Architecture (Lakehouse, Data Mesh), MLOps, gouvernance | Leadership technique, vision business | 75–95 K€ bruts |

| Lead / Staff | 8 ans et + | Stratégie data, mentoring, pilotage build/run | Influence, arbitrage, cadrage exécutif | 95–120 K€ bruts + variable |

Fourchettes indicatives consolidées à partir des grilles Glassdoor, PayScale et des études de cabinets spécialisés en 2025.

c. Architectures Big Data : du Data Warehouse au Lakehouse

Le choix de l’architecture de stockage est une décision stratégique qui impacte directement la performance et la flexibilité des analyses. Selon Databricks, le Data Lakehouse combine la flexibilité des Data Lakes (stockage de données brutes) et la performance des Data Warehouses (données structurées et modélisées pour la BI). Cette approche hybride permet de supporter à la fois les requêtes BI ultra-rapides et les explorations complexes des Data Scientists.

Pour approfondir ce sujet critique, consultez notre article sur comment mettre en place un Data Warehouse moderne avec Snowflake.

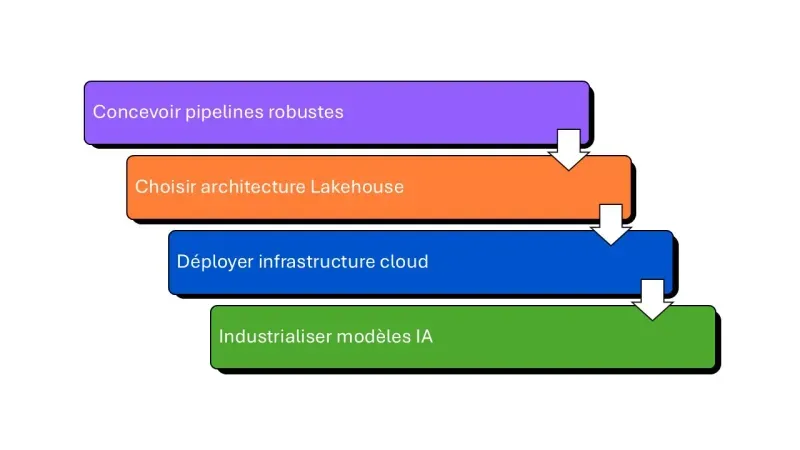

d. Cloud & MLOps : l’infrastructure de l’IA

Le Data Engineer moderne doit maîtriser les plateformes cloud (AWS, Azure, GCP) qui fournissent la puissance de calcul et les services managés indispensables pour l’entraînement et le déploiement des modèles d’IA à grande échelle. Le MLOps, dont les bonnes pratiques sont détaillées par Google Cloud dans son livre blanc de référence, applique les principes DevOps au cycle de vie du Machine Learning. Le rôle du Data Engineer est ici central pour :

- Automatiser le déploiement des modèles en production.

- Monitorer leur performance et détecter les dérives.

- Assurer la reproductibilité des entraînements.

Une bonne pratique MLOps permet de réduire significativement le temps de mise en production d’un modèle, transformant un projet de plusieurs mois en quelques semaines.

II. Les compétences Business Intelligence : transformer la donnée en décision

Industrialisez vos cas d’usage

Une fois l’infrastructure data solide en place, le Data Engineer doit s’assurer que les données sont non seulement accessibles mais aussi compréhensibles et actionnables par les utilisateurs finaux. Pour une DRH, c’est l’indicateur clé de montée en maturité : un Data Engineer qui parle aux métiers a deux fois plus d’impact qu’un profil 100 % technique.

a. Self-Service BI et visualisation : donner le pouvoir aux métiers

L’objectif de la BI moderne est de rendre les équipes métiers autonomes dans leur exploration des données. Le Data Engineer joue un rôle clé en préparant des « modèles de données » propres et optimisés qui servent de source unique de vérité pour les outils de Self-Service BI comme Power BI ou Tableau.

Pour y parvenir, il doit se concentrer sur plusieurs aspects :

- Modélisation sémantique : créer une couche de données simple et intuitive qui masque la complexité technique sous-jacente.

- Optimisation des performances : s’assurer que les requêtes des tableaux de bord s’exécutent rapidement.

- Sécurité des accès : configurer les droits pour que chaque utilisateur ne voie que les données qui le concernent.

b. Modélisation des données pour la performance

La modélisation des données est l’art de structurer l’information pour répondre aux questions business de la manière la plus efficace possible. Un bon modèle de données est la colonne vertébrale de tout système BI performant. Le Data Engineer doit maîtriser différentes techniques de modélisation (étoile, flocon) pour optimiser les performances des requêtes et la clarté des analyses.

Le tableau suivant compare l’impact de différentes approches de modélisation sur la performance BI :

| Approche de Modélisation | Performance des Requêtes | Facilité d’utilisation (Self-Service) | Flexibilité d’Analyse |

|---|---|---|---|

| Modèle en étoile | Très élevée | Très élevée | Modérée |

| Modèle en flocon | Élevée | Modérée | Élevée |

| Données dénormalisées | Faible | Faible | Très élevée |

| Modèle plat (une table) | Variable | Très faible | Faible |

La mise en place d’un modèle de données adapté améliore sensiblement l’adoption des outils BI par les utilisateurs finaux, car le temps d’accès aux informations diminue et la clarté augmente.

c. Gouvernance et qualité des données : le socle de la confiance

Une décision basée sur des données erronées peut coûter très cher. Le Data Engineer est le garant de la qualité et de la gouvernance des données. Il met en place les processus et les outils pour assurer que les données sont fiables, cohérentes, sécurisées et conformes au RGPD.

Les actions concrètes de la gouvernance des données incluent :

- Catalogue de données : documenter la signification, l’origine et l’usage de chaque donnée.

- Data Stewards : assigner des responsables métiers pour la qualité de leurs domaines de données respectifs.

- Monitoring qualité : implémenter des alertes automatiques pour détecter les anomalies (valeurs manquantes, formats incorrects, etc.).

Pour approfondir cette dimension stratégique, consultez notre article sur comment adopter une culture data-driven.

III. Les compétences stratégiques : devenir un partenaire de la croissance

Le Data Engineer le plus performant n’est pas seulement un expert technique, mais aussi un partenaire qui comprend les enjeux business et sait communiquer la valeur de la donnée. Ce sont ces compétences stratégiques qui font la différence — et ce sont elles qui, selon dbt Labs (2025), séparent les profils « exécutants » des profils « impactants » sur le marché.

a. Compréhension des enjeux métiers et ROI

Pour construire des solutions data pertinentes, le Data Engineer doit comprendre les objectifs de l’entreprise : réduire les coûts, augmenter les ventes, optimiser la production. Cette compréhension lui permet de prioriser les projets qui auront le plus grand retour sur investissement (ROI). Un projet data déconnecté des réalités métiers est significativement plus exposé aux risques d’échec.

Questions à intégrer à vos entretiens d’embauche ou vos revues annuelles :

- Quels sont les 3 principaux KPI que votre département cherche à améliorer ?

- Comment le pipeline de données construit contribue-t-il directement à l’un de ces objectifs ?

b. Communication et Data Storytelling

Savoir construire des systèmes complexes est une chose, savoir en expliquer la valeur en est une autre. Le Data Engineer doit être capable de vulgariser des concepts techniques pour des audiences non-techniques (managers, directeurs marketing, COMEX). Il ne s’agit pas de présenter des lignes de code, mais de raconter l’histoire que les données révèlent.

Les piliers d’une communication efficace sont :

- La visualisation : utiliser des graphiques simples et clairs pour illustrer un point.

- Le contexte : expliquer ce que les chiffres signifient pour l’entreprise.

- La narration : structurer la présentation comme une histoire, avec un début, un développement et une conclusion actionnable.

c. Veille technologique et innovation continue

L’écosystème data évolue à une vitesse fulgurante. Les outils et méthodes standards aujourd’hui seront peut-être dépassés dans deux ans. Le Data Engineer doit consacrer une partie régulière de son temps à la veille technologique et à l’auto-formation pour rester pertinent.

Cela implique de suivre les tendances émergentes comme l’IA générative, les architectures Data Mesh popularisées par Martin Fowler, ou les nouvelles plateformes de traitement en temps réel. Les équipes data qui adoptent une démarche d’amélioration continue constatent une accélération notable de leurs cycles de développement.

IV. Recruter, former, fidéliser : le plan d’action RH / DSI

Au-delà du référentiel, voici les leviers concrets à activer pour construire une équipe data performante et durable.

a. Recruter dans un marché tendu

D’après France Travail (BMO 2025), les métiers data figurent parmi les plus difficiles à pourvoir dans le numérique. Pour réussir vos recrutements :

- Élargissez le vivier : ouvrez les postes à des profils issus du développement logiciel, de la BI ou de l’analytics en reconversion.

- Accélérez le process : un Data Engineer senior reçoit en moyenne plusieurs offres concurrentes, un process qui dure plus de 4 semaines perd la majorité des candidats.

- Soignez la marque employeur technique : partagez vos cas d’usage, vos choix d’architecture, vos contributions open source.

b. Faire monter en compétences les équipes existantes

La montée en compétences interne est souvent plus rapide et moins coûteuse qu’un recrutement externe. Une formation ciblée de 8 à 12 jours sur la modern data stack (dbt, Airflow, Snowflake) permet à un développeur senior ou à un analyste BI de basculer efficacement vers un poste de Data Engineer junior-intermédiaire.

c. Fidéliser : au-delà du salaire

Selon Glassdoor (2025), le salaire n’est pas le premier facteur de départ d’un Data Engineer. Viennent avant : la stagnation technique, le manque de projets à impact, et l’absence d’architecture propre. Les leviers de rétention les plus efficaces :

- Allouer 10 à 20 % du temps à la veille, la R&D ou les contributions open source.

- Construire un plan de carrière clair (Data Engineer → Senior → Lead / Staff / Architecte).

- Investir dans la qualité de la plateforme : dette technique maîtrisée, outils modernes, observabilité.

Conclusion

Recruter et fidéliser un Data Engineer en 2025 ne se résume pas à une fiche de poste technique. C’est un exercice stratégique qui mobilise la DRH, la DSI et les directions métiers autour d’un référentiel commun : compétences techniques, BI, soft skills, vision business. Les entreprises qui structurent cette démarche — grille de séniorité, plan de formation, trajectoire de carrière — transforment leur équipe data en véritable avantage compétitif. Les autres continueront à subir la tension du marché.

Vous souhaitez structurer votre stratégie de recrutement ou de formation data ? Demandez un diagnostic →

Expertises liées