Gemini CLI : l'agent de terminal de Google face à Claude Code

Pour un CTO ou une DSI, le choix d’un agent de coding en terminal n’est plus anecdotique : il engage un coût récurrent, une dépendance fournisseur et une exposition sécurité. Depuis que Google a ouvert Gemini CLI en open source (licence Apache 2.0), la question ne se résume plus à Claude Code ou rien. Ce comparatif vise à vous donner les critères d’arbitrage concrets : pricing, benchmarks, gouvernance, scalabilité. L’objectif n’est pas de désigner un gagnant universel, mais d’identifier quel outil pour quel profil d’usage, à quel coût complet.

Réponse courte : les deux sont matures, mais ils n’optimisent pas la même variable.

Ce que Gemini CLI fait bien

La guerre des CLI est déclarée.

Une ergonomie pensée pour le terminal

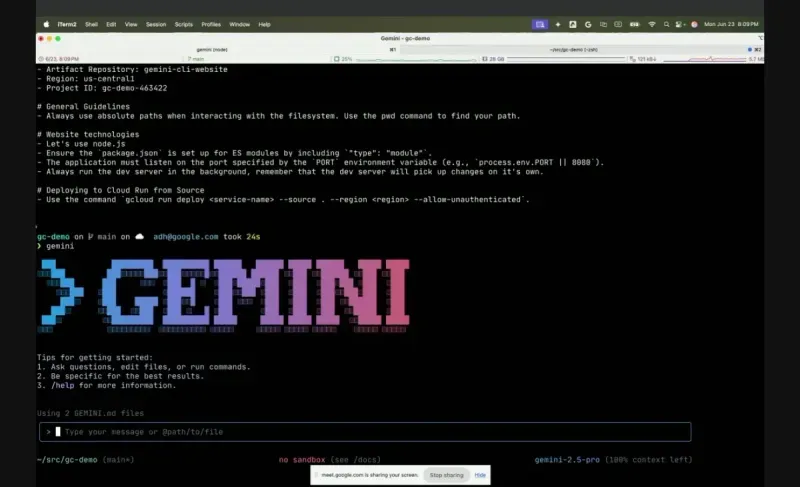

Gemini CLI s’installe en une ligne (npm install -g @google/gemini-cli) et se lance avec la commande gemini. L’interface reprend les codes des outils CLI modernes : chaque action de l’agent est regroupée dans des blocs visuels distincts, ce qui rend le flux de travail lisible même sur des sessions longues. Pour un Lead Dev qui doit onboarder une équipe, la courbe d’apprentissage est courte.

Le fichier GEMINI.md joue le rôle de prompt système persistant : placé à la racine du repo, il charge le contexte projet, les conventions de code, les contraintes métier. C’est l’équivalent du CLAUDE.md d’Anthropic. Une orchestration par repo qui permet de pré-initialiser l’agent avec une connaissance précise de l’environnement avant même la première requête.

Un tier gratuit réellement utilisable

C’est probablement le différenciateur le plus fort. Selon l’annonce officielle de Google (2025), Gemini CLI donne accès à 60 requêtes par minute et 1 000 requêtes par jour sur les modèles Gemini 3 avec un simple compte Google. Aucun autre outil de ce niveau ne propose un free tier aussi généreux. Pour une phase de POC, une PME en phase d’évaluation ou un développeur solo, c’est un argument de poids face à Claude Code qui nécessite un abonnement payant dès le départ.

La question du coût est d’ailleurs centrale dans tout projet d’IA en production. Si vous intégrez des agents IA à grande échelle, la maîtrise de la facture devient un enjeu stratégique. C’est tout le sujet du LLM FinOps : stratégies pour auditer, contrôler et réduire vos coûts de tokens.

Intégration agentique avancée et coût réduit sur API

Gemini CLI supporte nativement les MCP servers (Model Context Protocol, spec Anthropic 2025), les hooks dans la boucle agentique, et les commandes personnalisées. Sur le coût API, Gemini 3 Flash — le modèle optimisé pour les workflows à haute fréquence — est disponible à une fraction du prix de Gemini 3 Pro. D’après les scores publiés sur SWE-Bench Verified, Flash obtient 78 % sur les tâches de coding agentique, dépassant même son grand frère Pro sur certaines tâches. Concrètement : les tâches courantes passent automatiquement sur Flash, les raisonnements complexes escaladent sur Pro. Moins cher, sans compromis visible sur le quotidien.

Gestion dynamique des modèles en session

Une fonctionnalité qui mérite d’être soulignée : le routing intelligent automatique. Gemini CLI choisit en temps réel entre Gemini 3 Flash et Gemini 3 Pro selon la complexité perçue de la tâche. Et si l’auto-routing ne convient pas, la commande /model permet de switcher manuellement en cours de session, sans relancer, sans perdre le contexte. Pour les équipes qui alternent entre refactoring lourd et questions rapides, c’est un gain de fluidité réel.

Ce mécanisme de routing entre modèles légers et modèles puissants est une tendance de fond. On retrouve cette logique dans les architectures combinant Small Language Models (SLM) et LLM, où le choix du bon modèle pour la bonne tâche permet d’optimiser à la fois le coût et la performance.

Écosystème complet pour utilisateurs avancés

Gemini CLI embarque tout ce qu’on attend d’un outil agentique mature :

- MCP servers — connexion à des outils externes (Google Drive, bases de données, APIs métier)

- Hooks — scripts déclenchés à des points précis de la boucle agentique (avant/après chaque outil, au démarrage de session), calqués sur le modèle de Claude Code Hooks mais avec une douzaine d’événements de cycle de vie

- Git integration — lecture du contexte repo, diff, gestion des branches

- Système de permissions granulaire — contrôle fin sur ce que l’agent peut ou ne peut pas faire

- Skills (agents spécialisés) — fichiers Markdown avec frontmatter YAML définissant un agent dédié à une tâche précise, stockés au niveau projet (

.gemini/agents/) ou utilisateur (~/.gemini/agents/)

L’ensemble est open source sous licence Apache 2.0. Pour une DSI soumise à des contraintes réglementaires, cette transparence permet audit de code, contribution et, si besoin, fork. Dans les critères techniques et juridiques à considérer pour choisir un LLM, nous détaillons ces enjeux dans notre guide pour choisir son LLM open source.

Interface de Gemini CLI.

Là où Claude Code reste devant

Les sub-agents : la parallélisation fait la différence

C’est le point de friction principal. Gemini CLI dispose bien de sub-agents, mais ils sont marqués comme expérimentaux et doivent être activés manuellement dans les settings. Surtout, ils fonctionnent de manière séquentielle : un sub-agent à la fois, qui reporte au main agent avant que le suivant soit lancé.

Claude Code, lui, a introduit les Agent Teams en février 2026 selon la documentation Anthropic : plusieurs sub-agents qui tournent en parallèle avec des fenêtres de contexte dédiées et un orchestrateur central qui gère les conflits et synchronise les résultats. Concrètement, sur un refactoring multi-fichiers, Claude peut faire tourner simultanément un agent sur la couche data, un autre sur les routes API, un troisième sur les tests. Gemini traite tout ça en séquence. Sur des tâches complexes, la différence de temps est perceptible — et donc le coût total aussi.

Cette notion d’orchestration multi-agents est un enjeu central de l’IA moderne. Pour comprendre en profondeur comment ces architectures fonctionnent, consultez notre article sur la construction de systèmes multi-agents.

Un benchmark qui tranche sur les tâches complexes

Sur SWE-Bench Verified — le benchmark public de référence pour les agents de coding — Claude Code affiche un score de 80,9 % contre 78 % pour Gemini 3 Flash. Un benchmark indépendant publié par Render (Testing AI coding agents, 2025) a comparé ces outils sur des tâches réelles de déploiement : Claude a finalisé la mission en 4,80 $ avec exécution fluide, là où Gemini a cumulé 7,06 $ à cause d’échecs successifs nécessitant des relances manuelles. Sur le coût total de possession, l’écart de pricing affiché s’inverse partiellement dès que les tâches se complexifient.

Une gestion du contexte plus fine

Gemini s’appuie sur sa fenêtre de contexte de 1 million de tokens pour maintenir la cohérence sur un repo entier. Puissant pour lire de grands codebases. Mais Claude Code va plus loin : il construit en interne un knowledge graph sémantique du projet, en mappant les dépendances via des syntax trees. Il charge dynamiquement les fichiers pertinents selon la tâche, maximisant l’utilité de son contexte plutôt que de tout ingérer brut.

En pratique, Claude a une compréhension architecturale plus profonde. Il comprend pourquoi les fichiers sont liés, pas seulement qu’ils existent. Gemini peut nécessiter des indications plus explicites pour naviguer les mêmes relations et reste sensible au context root, malgré la taille de sa fenêtre.

Sécurité et gouvernance : un enjeu transversal

Quel que soit l’outil choisi, la sécurité reste un point d’attention critique — et pour une DSI, c’est souvent le critère bloquant. Les agents de terminal ont accès au système de fichiers, au réseau, et peuvent exécuter du code de manière autonome. Selon la documentation Anthropic, Claude Code exige une permission explicite avant chaque modification de fichier ou exécution de commande. Gemini CLI propose un système de permissions granulaires équivalent, mais le risque ne se limite pas à l’outil lui-même.

Le prompt injection — technique qui consiste à manipuler le comportement d’un LLM via des instructions cachées dans le contexte — est un vecteur d’attaque particulièrement pertinent pour les agents de terminal qui lisent et analysent du code tiers. Notre analyse détaillée sur le Prompt Injection : comprendre et bloquer cette nouvelle menace IA explore les mécanismes de défense à mettre en place.

Plus largement, la délégation de décisions techniques à des agents autonomes soulève des questions de gouvernance et d’éthique de l’IA agentique : traçabilité des actions, périmètre d’action, responsabilité en cas d’erreur, audit trail. Ces enjeux sont d’autant plus critiques que ces outils s’inscrivent désormais dans des workflows de production.

Tableau comparatif : Gemini CLI vs Claude Code

| Critère | Gemini CLI | Claude Code |

|---|---|---|

| Prix d’entrée | Gratuit (1 000 req/jour, 60 req/min) | Payant (Pro 20 $/mois minimum) |

| Modèles | Gemini 3 Flash / Pro, auto-routing | Claude Opus 4.7, Sonnet 4.5 |

| Context window | 1 M tokens (standard) | ~200 K tokens + knowledge graph |

| SWE-Bench Verified | 78 % (Gemini 3 Flash) | 80,9 % (Opus 4.7) |

| Sub-agents / parallélisation | Expérimental, séquentiel | Agent Teams, parallèle natif |

| Gestion du contexte | Fenêtre brute large | Knowledge graph sémantique |

| MCP / Hooks / Git | Complet | Complet |

| Licence | Open source Apache 2.0 | Propriétaire |

| Search natif | Google Search intégré | Navigateur Chrome via crawler |

| Plan Mode | Oui (par défaut depuis v0.34) | Oui |

| Cas d’usage type | POC, exploration codebase, PME en évaluation | Refactoring multi-fichiers, équipes prod |

Déployer ces outils à l’échelle : les questions à se poser

Au-delà du choix entre Gemini CLI et Claude Code, les équipes qui industrialisent l’usage d’agents IA doivent anticiper plusieurs dimensions :

- Monitoring en production — Suivre les performances, détecter les dérives et les anomalies est indispensable. Notre guide sur l’optimisation et monitoring d’un LLM en production détaille les outils et bonnes pratiques.

- Architecture de déploiement — Cloud, on-premise ou hybride ? Le choix dépend des contraintes de sécurité, de latence et de coût. Notre comparatif des architectures de déploiement LLM aide à arbitrer.

- Confidentialité des données — Les agents de coding traitent du code propriétaire. Pour les entreprises soumises à des contraintes réglementaires, le déploiement d’un LLM sur site peut être la seule option viable.

- Coût complet (TCO) — Intégrer licences, tokens API, temps d’onboarding, maintenance des prompts (

GEMINI.md/CLAUDE.md), et coût opportunité des tâches ratées. Un outil moins cher qui rate 20 % de ses missions coûte plus cher qu’un outil premium fiable.

Ce qu’il faut retenir

Gemini CLI est l’outil parfait pour commencer avec le développement agentique sans friction financière, pour les projets sur de grands codebases qui bénéficient du contexte 1 M tokens, et pour les équipes déjà dans l’écosystème Google Cloud (Vertex AI, Cloud Functions, BigQuery). Claude Code reste la référence pour les workflows complexes multi-fichiers, les tâches qui gagnent à être parallélisées, et les équipes qui privilégient la précision architecturale à l’échelle.

La bonne nouvelle pour un CTO : les deux ne sont pas mutuellement exclusifs. Une stratégie observée en 2026 consiste à utiliser Gemini CLI pour les tâches quotidiennes et l’exploration de codebase (coût marginal nul, contexte large), en escaladant vers Claude Code pour les refactorings critiques (qualité, parallélisation). L’arbitrage se fait tâche par tâche, pas outil par outil.

Pour les PME qui découvrent ces approches, les agents IA de coding ne sont qu’une facette de la transformation agentique. Découvrez comment les agents IA transforment les métiers en PME et comment les tendances Microsoft autour des agents IA autonomes redéfinissent l’automatisation professionnelle.

Flowt — Agence Data & IA. Experts certifiés en Data Science, Machine Learning et IA Générative.

Vous souhaitez structurer votre stratégie d’agents IA en entreprise ? Demandez un diagnostic →

Expertises liées